RAGとは?企業が社内ナレッジをAIで活用するための構築ガイド【2026年最新】

はじめに:生成AIの「嘘」に悩んでいませんか?

2022年のChatGPTの登場以降、生成AIはビジネスの世界に大きな変革をもたらしました。多くの企業が業務効率化や新たな顧客体験の創出を目指し、生成AIの活用を模索しています。しかしその一方で、生成AIがもっともらしい「嘘」の回答を生成してしまうハルシネーションという問題や、学習データに社内の機密情報や最新情報が含まれていないため、実践的な業務に活用しきれないという課題も浮き彫りになっています。

これらの課題を解決する技術として、今、大きな注目を集めているのが**RAG(Retrieval-Augmented Generation:検索拡張生成)**です。RAGは、大規模言語モデル(LLM)が持つ高度な文章生成能力と、信頼できる情報源からの正確な情報を組み合わせることで、生成AIの回答精度と信頼性を飛躍的に向上させる仕組みです。

この記事では、企業のDX推進担当者や経営層の方々に向けて、RAGの基本的な仕組みから、具体的な導入メリット、構築ステップ、そして成功のための重要なポイントまでを、網羅的かつ分かりやすく解説します。この記事を最後まで読めば、RAGが自社のビジネス課題をどのように解決し、競争優位性をいかに高めるかを具体的にイメージできるようになるでしょう。

RAG(検索拡張生成)とは?

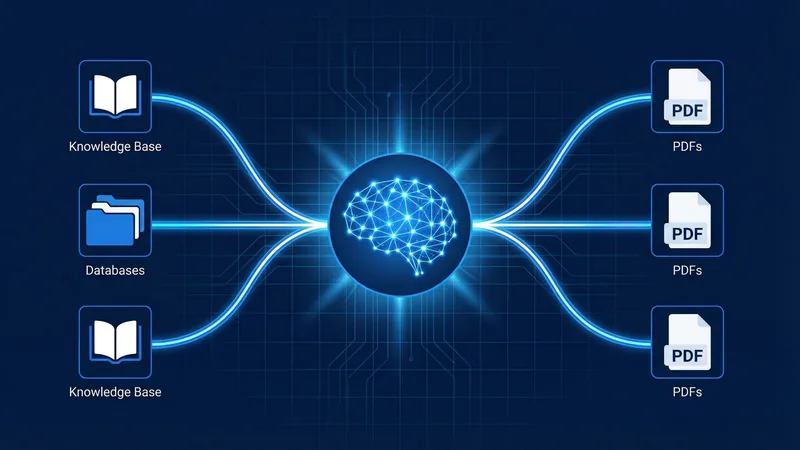

RAG(Retrieval-Augmented Generation)とは、その名の通り「検索(Retrieval)」によって得られた情報で、LLMによるテキスト生成を「拡張(Augmented)」する技術です。日本語では「検索拡張生成」と訳されます。この技術は、LLMが元々持っている膨大な知識に加え、外部の信頼できる最新情報や社内独自のデータベースを参照することで、より正確で文脈に沿った回答を生成することを可能にします。

RAGの基本的な仕組み

RAGの仕組みは、大きく分けて以下の3つのステップで構成されます。

- 検索(Retrieval): ユーザーからの質問や指示が入力されると、まずその内容に関連する情報を、あらかじめ準備されたナレッジベース(社内文書、ウェブサイト、データベースなど)から検索します。

- 拡張(Augmented): 検索して見つけ出した関連情報を、元の質問や指示に付加(拡張)し、LLMへの入力(プロンプト)を作成します。

- 生成(Generation): 拡張されたプロンプトを受け取ったLLMは、付加された情報を「根拠」として参照しながら、最終的な回答を生成します。

このプロセスは、まるで専門家が参考資料を調べながら質問に答える様子に似ています。LLM単体では、その「頭の中」にある知識だけで答えようとするため、情報が古かったり、誤った情報を記憶していたりするリスクがあります。一方、RAGを用いることで、常に最新かつ正確な情報源を基にした回答生成が実現できるのです。

| LLM単体での応答 | RAGを用いた応答 | |

|---|---|---|

| 情報源 | 事前学習データのみ | 事前学習データ + 外部ナレッジベース |

| 情報の鮮度 | 学習時点に依存(古い) | リアルタイムに更新可能(最新) |

| 回答の根拠 | 不明瞭 | 参照した情報源を提示可能 |

| ハルシネーション | 発生しやすい | 抑制されやすい |

| 専門性 | 一般的な知識 | 特定のドメイン(社内情報など)に特化可能 |

なぜ今、RAGがビジネスで重要なのか?

現代のビジネス環境において、企業は日々膨大な量のデータを生成・蓄積しています。顧客情報、取引履歴、技術文書、社内規定、過去のプロジェクト資料など、これらはすべて企業の競争力の源泉となる「知的資産」です。しかし、これらの貴重なデータが十分に活用されず、サイロ化しているケースは少なくありません。

RAGは、これらの企業独自のデータを生成AIと結びつけることで、その価値を最大限に引き出すための鍵となります。従来、AIに専門知識を教え込むためには、LLMを特定のデータで再学習させる「ファインチューニング」という手法が一般的でした。しかし、ファインチューニングには、大量の高品質な学習データが必要であり、膨大な計算コストと時間がかかるという高いハードルがありました。

RAGは、このファインチューニングに比べて、はるかに低コストかつ迅速に導入できるという大きな利点があります。既存のLLMモデルをそのまま活用し、外部のナレッジベースを切り替えるだけで、様々な専門領域に対応したAIを構築できるのです。この導入の手軽さと高い費用対効果が、多くの企業にとってRAGが現実的かつ強力なソリューションとなっている理由です。

企業がRAGを導入する5つのメリット

メリット1:回答精度の劇的な向上とハルシネーションの抑制

RAGを導入する最大のメリットは、回答精度の劇的な向上です。LLMは、その学習過程でインターネット上の膨大なテキストデータを参照しますが、その中には誤った情報や古い情報も含まれています。そのため、LLM単体では事実に基づかない回答、すなわち「ハルシネーション」を生成してしまうリスクが常に伴います。RAGは、回答を生成する際に、信頼できる特定の情報源(ナレッジベース)を参照することを強制します。これにより、AIは「知らないことは答えない」「根拠のあることだけを話す」という原則に従うようになり、ハルシネーションを大幅に抑制できるのです。

メリット2:最新情報や社内ナレッジに基づいた回答

LLMの知識は、そのモデルが学習された時点の情報で固定されています。そのため、最新のニュース、市場動向、あるいは日々更新される社内ドキュメントの内容を反映することはできません。RAGは、外部のナレッジベースをリアルタイムで参照するため、常に最新の情報に基づいた回答を生成できます。例えば、昨日更新されたばかりの社内規定に関する質問や、今朝発表された新製品のスペックに関する問い合わせにも、即座に正確な情報を提供することが可能になります。

メリット3:情報ソースの提示による信頼性の確保

ビジネスにおける意思決定では、情報の信頼性が極めて重要です。RAGは、AIが回答を生成する際に参照した情報源(ドキュメント名、ページ番号、URLなど)を明示することができます。これにより、ユーザーは回答の根拠を自らの目で確認し、ファクトチェックを容易に行うことができます。情報ソースが明確であることは、AIの回答に対する信頼性を高め、ユーザーが安心してシステムを利用するための基盤となります。

メリット4:LLMの再学習が不要で、コストと時間を削減

前述の通り、LLMに新たな知識を教えるための「ファインチューニング」には、専門的な知識と多大なコスト、そして長い時間が必要です。RAGは、このファインチューニングのプロセスを必要としません。ナレッジベースに新しいドキュメントを追加・更新するだけで、AIの知識をアップデートできるため、非常に効率的です。これにより、企業はAIシステムを迅速に立ち上げ、運用コストを抑えながら、常に最新の状態に保つことができます。

メリット5:セキュアな環境でのデータ活用

多くの企業にとって、社内の機密情報や顧客データをどのように扱うかは、AI活用における重要な懸念事項です。パブリックなLLMサービスにこれらの情報をアップロードすることは、情報漏洩のリスクを伴います。RAGアーキテクチャでは、機密情報を含むナレッジベースを自社のセキュアな環境(オンプレミスやプライベートクラウド)内に保持したまま、LLMの推論能力のみを利用することが可能です。LLMには質問と関連情報のみが渡され、元のデータが外部に送信されることはありません。これにより、企業はセキュリティを確保しながら、自社の貴重なデータ資産を安全に活用することができます。

RAGの具体的な活用シーン

【社内向け】業務効率化の実現

RAGは、社内に散在する膨大な情報を連結し、従業員の生産性を飛躍的に向上させる可能性を秘めています。

高度な社内情報検索システムとして活用すれば、従業員が「昨年度のマーケティング戦略に関する報告書はどこ?」「新製品の技術仕様について教えて」といった自然言語で質問するだけで、膨大な社内規定、技術文書、過去の議事録、プロジェクト報告書などから、AIが目的の情報を瞬時に探し出し、要約して提示します。これにより、情報検索にかかっていた時間を大幅に削減し、従業員はより付加価値の高い業務に集中できます。

また、次世代型FAQチャットボットとしての活用も効果的です。人事、経理、ITサポートなど、バックオフィス部門には日々同様の問い合わせが数多く寄せられます。RAGを活用したチャットボットを導入すれば、社内マニュアルや規定集をナレッジベースとして、従業員からの質問に24時間365日、自動で回答できます。これにより、担当者の問い合わせ対応業務の負荷を軽減し、従業員の自己解決を促進します。

【社外向け】顧客満足度の向上

顧客との接点においても、RAGは新たな価値を創出します。

インテリジェントなカスタマーサポートでは、顧客からの複雑な問い合わせに対し、過去の対応履歴、製品マニュアル、FAQデータベースなどを参照し、文脈を理解した上で的確な回答を自動生成します。これにより、オペレーターはより高度な問題解決に専念でき、応答時間の短縮と解決率の向上を実現します。結果として、顧客満足度の大幅な向上が期待できます。

パーソナライズされた製品・サービス推薦も有力な活用シーンです。ECサイトや会員向けサービスにおいて、顧客一人ひとりの購買履歴、閲覧行動、問い合わせ内容などをナレッジベースとして活用します。RAGはこれらの情報を分析し、個々の顧客の興味やニーズに合致した製品やサービスを、説得力のある説明と共に推薦します。これにより、アップセルやクロスセルを促進し、顧客エンゲージメントを高めることができます。

RAGシステムの構築7ステップ

RAGシステムの構築は、単にツールを組み合わせるだけでは成功しません。戦略的な計画と段階的な実装が不可欠です。ここでは、RAGシステムを構築するための標準的な7つのステップを解説します。

ステップ1:目的と要件の定義

最初に、「RAGシステムを導入して何を解決したいのか」という目的を明確に定義します。例えば、「カスタマーサポートの応答時間を30%削減する」「社内のドキュメント検索にかかる時間を半減させる」といった具体的な目標を設定することが重要です。その上で、システムに求められる機能、対象とするユーザー、性能目標(応答速度、精度など)、セキュリティ要件などを詳細に定義します。この初期段階での明確な定義が、プロジェクト全体の方向性を決定づけます。

ステップ2:ナレッジソースの準備と前処理

RAGの回答品質は、元となるデータの品質に大きく依存します。社内に散在するドキュメント(PDF, Word, HTML, Markdownなど)、データベース、FAQなど、ナレッジの源泉となるデータを収集します。収集したデータは、そのままではAIが利用しにくいため、「前処理(クリーニング)」が必要です。不要な情報の削除、フォーマットの統一、誤字脱字の修正などを行い、データの品質を高めます。

ステップ3:ベクトルデータベースの選定と構築

前処理されたテキストデータを、AIが意味を理解できる「ベクトル」という数値の配列に変換し、専用の「ベクトルデータベース」に格納します。ベクトルデータベースは、テキストの意味的な類似度に基づいて高速に情報を検索することに特化した、まさに「AI時代のデータベース」です。代表的なものには、Pinecone、Weaviate、Chromaなどがあり、プロジェクトの規模や要件に応じて最適なものを選定します。

ステップ4:検索(リトリーバー)モデルの選定

ユーザーからの質問が入力された際に、ベクトルデータベースから最も関連性の高い情報(ドキュメント)を効率的に見つけ出すのが、検索(リトリーバー)モデルの役割です。この検索精度が、最終的な回答の質を大きく左右します。単純なキーワード検索だけでなく、質問の意図や文脈を理解して検索を行うセマンティック検索の能力が求められます。

ステップ5:LLM(生成モデル)の選定

検索モデルが見つけ出した情報を基に、最終的な回答を生成するのがLLM(生成モデル)です。GPT-4、Claude、Geminiなど、様々なLLMが存在し、それぞれに得意なタスクや性能、コストが異なります。例えば、高度な推論能力が求められる場合は高性能なモデルを、定型的な応答で十分な場合はコストパフォーマンスに優れたモデルを選ぶなど、目的と予算に応じて最適なLLMを選定することが重要です。

ステップ6:全体のインテグレーションとUI開発

これまでに選定・構築した各コンポーネント(ベクトルデータベース、検索モデル、LLM)を連携させ、一つのシステムとして統合します。同時に、ユーザーが直感的に操作できるインターフェース(UI)、例えばチャット画面や検索画面を開発します。ユーザーがストレスなくシステムを利用できるかどうかが、導入後の定着を左右する重要な要素です。

ステップ7:評価とチューニング

システムを構築して終わりではありません。実際に運用を開始し、ユーザーからのフィードバックや利用データを基に、回答の精度を継続的に評価し、改善していくプロセスが不可欠です。例えば、「期待した回答が得られなかった」「関連性の低い情報を参照している」といった問題点を分析し、データの分割方法(チャンキング)の調整、検索ロジックの改良、LLMへの指示(プロンプト)の最適化などを繰り返し行い、システムの性能を磨き上げていきます。

RAG構築を成功させるための重要ポイント

データ品質が成功の9割を決める

「Garbage In, Garbage Out(ゴミを入れれば、ゴミしか出てこない)」という原則は、RAGシステムにおいて特に重要です。AIの回答の質は、参照するデータの質に直接的に影響されます。情報が古かったり、誤っていたり、あるいは整理されていなかったりすると、AIは正確な回答を生成することができません。RAGプロジェクトを成功させるためには、まずナレッジベースとなるデータの品質を確保し、継続的にメンテナンスしていく体制を整えることが、成功の9割を決めると言っても過言ではありません。

適切な「チャンクサイズ」の設計

ナレッジベースのドキュメントは、AIが処理しやすいように、ある程度の大きさの塊(チャンク)に分割されます。この「チャンクサイズ」の設計は、回答の精度に大きな影響を与える、非常に繊細なチューニング項目です。チャンクが小さすぎると、回答を生成するのに十分な文脈が失われてしまい、断片的な回答になりがちです。逆に、チャンクが大きすぎると、ノイズとなる無関係な情報が多く含まれてしまい、回答の精度が低下する可能性があります。ドキュメントの種類や内容、想定される質問に応じて、最適なチャンクサイズを見つけ出す試行錯誤が求められます。

キーワード検索とベクトル検索のハイブリッド活用

最新のRAGシステムでは、検索精度をさらに向上させるために、異なる検索手法を組み合わせる「ハイブリッド検索」がトレンドとなっています。具体的には、単語の完全一致で検索する伝統的な「キーワード検索」と、意味の類似性で検索する「ベクトル検索(セマンティック検索)」を組み合わせるアプローチです。キーワード検索は、製品名や型番といった固有名詞の検索に強い一方、ベクトル検索は、抽象的な概念や言い換え表現に強いという特徴があります。両者を組み合わせることで、それぞれの長所を活かし、検索の網羅性と精度を両立させることができます。

コストとパフォーマンスの最適なバランスを見極める

RAGシステムを構成するLLMやベクトルデータベースなどのコンポーネントは、一般的に性能が高くなるほど利用コストも上昇します。例えば、最先端の高性能LLMは、非常に高度な文章生成能力を持ちますが、APIの利用料も高額になる傾向があります。プロジェクトの要件と予算を照らし合わせ、「どの程度の回答品質が求められるのか」「許容できるコストはいくらか」を慎重に見極め、コストとパフォーマンスの最適なバランスを取ることが、持続可能なシステム運用のためには不可欠です。

ArcHackのRAG構築支援サービス

RAGシステムの構築は、多くの企業にとって未経験の領域であり、技術的なハードルやプロジェクト推進のノウハウ不足が課題となりがちです。ArcHackは、お客様のビジネスに寄り添い、AI活用の戦略立案から実装、運用までをワンストップで支援するプロフェッショナル集団です。

なぜArcHackが選ばれるのか?

深い専門領域への知見として、私たちは特に製薬業界をはじめとする高度な専門知識が求められる領域でのAI導入に豊富な実績を持っています。業界特有の課題やデータ形式を深く理解し、お客様のビジネスに真に貢献するRAGシステムを構築します。

CxOレベルでの伴走経験も大きな強みです。私たちのコンサルタントは、単なる技術提供に留まりません。お客様の経営課題を深く理解し、CxOレベルの視座でAI戦略の立案から実行までを伴走支援します。技術とビジネスの両面から、プロジェクトを成功へと導きます。

コンペ受賞実績のある技術力として、私たちのエンジニアチームは国内外のAIコンペティションで多数の受賞歴を誇ります。その高い技術力と探究心で、常に最先端の技術動向を捉え、お客様に最適なアーキテクチャを設計・実装します。

まずは無料相談から

「自社のデータをもっと活用したい」「生成AIを導入したいが、何から始めれば良いかわからない」――そのようなお悩みをお持ちでしたら、ぜひ一度ArcHackにご相談ください。お客様の課題をヒアリングし、AI活用の専門家が具体的な解決策をご提案します。

まとめ

本記事では、生成AIの新たな可能性を切り拓く技術「RAG(検索拡張生成)」について、その仕組みからビジネスにおけるメリット、具体的な構築ステップ、そして成功のポイントまでを包括的に解説しました。

RAGは、生成AIが抱えるハルシネーションのリスクを抑制し、企業の持つ独自の最新情報や専門知識をAIの回答に反映させることを可能にします。これにより、企業は社内外の様々なシーンでAIを活用し、業務効率化、顧客満足度の向上、そして新たなビジネス価値の創出を実現できます。

RAGシステムの構築は決して容易な道のりではありませんが、その先には、自社の知的資産を最大限に活用し、データドリブンな意思決定を加速させる未来が待っています。この記事が、皆様にとってその第一歩を踏み出すきっかけとなれば幸いです。